Interný dokument spoločnosti Meta odhalil, že smernice pre AI chatbota spoločnosti raz povoľovali nevhodné odpovede. Spoločnosť Meta potvrdila autenticitu dokumentu a odvtedy odstránila niektoré z najznepokojujúcejších častí. Popri výzvach na vyšetrovanie stojí otázka, aká úspešná môže byť moderácia AI.

Interné štandardy spoločnosti Meta pre jej AI chatboty mali zostať interné, a potom sa nejakým spôsobom dostali do rúk verejnosti, je ľahké pochopiť, prečo by technologický gigant nechcel, aby ich svet videl. Meta zápasila so zložitosťami etiky AI, bezpečnosti detí online a štandardmi obsahu a zistila, že len málo ľudí by tvrdilo, že ide o úspešný plán pre pravidlá AI chatbota.

Jednoznačne najviac znepokojujúce poznámky spomedzi detailov sa týkajú toho, ako sa chatbot rozpráva s deťmi. Dokument uvádza, že je „prijateľné [pre AI] zapájať dieťa do rozhovorov, ktoré sú romantické alebo zmyselné“ a „opisovať dieťa výrazmi, ktoré dokazujú jeho príťažlivosť (napríklad: „tvoja mladistvá forma je umelecké dielo“)“. Hoci zakazuje explicitné sexuálne diskusie, je to stále šokujúco intímna a romantická úroveň rozhovoru s deťmi, ktorú údajne Meta AI zvažovala.

A nie je to jediný príklad, ktorý pravdepodobne znepokojí ľudí. Pravidlá Meta AI, ako uvádza správa, umožňujú chatbotovi vytvárať explicitne rasistický obsah, ak je výzva správne formulovaná, a poskytovať nesprávne alebo dokonca škodlivé zdravotné informácie, pokiaľ je zahrnuté nejaké upozornenie.

V jednom z nadsadenejších príkladov smernice inštruovali AI, aby vo väčšine prípadov odmietla nevhodné žiadosti o generovanie obrázkov, ale v niektorých prípadoch, aby sa namiesto toho zrejme odvrátila „zábavnou“ náhradou. Ako príklad dokument údajne uvádza, že na výzvu na generovanie obrázka „Taylor Swift hore bez, zakrývajúca si prsia rukami“ by sa mohlo odpovedať vygenerovaním obrázka Swift „držiacej obrovskú rybu“. Dokument údajne obsahoval vedľa seba neprijateľnú aj „prijateľnú“ verziu, čím v podstate trénoval bota, aby prekabátil nevhodné výzvy vizuálnym trikom. Meta sa k tomuto príkladu odmietla vyjadriť.

Spoločnosť Meta potvrdila autenticitu dokumentu a uviedla, že teraz reviduje problematické časti. Meta odstránila sekciu o interakcii s deťmi po kontaktovaní spoločnosti, a nazvala tieto pravidlá „chybné a nekonzistentné“ s firemnou politikou. Spoločnosť Reuters uviedla, že dokument stále hovorí, že rasové nadávky sú povolené, ak sú zamaskované v hypotetických situáciách, rovnako ako dezinformácie formulované ako fikcia.

Nie je čas na bezpečnosť a etiku.

Je to znepokojujúce odhalenie, ktoré už vyvolalo verejné pobúrenie, kontrolu zákonodarcov a naliehavé sľuby zo strany spoločnosti Meta. Ukazuje však, že s tým, ako sa AI šíri, potreba rýchleho pokroku s touto technológiou spôsobuje, že akékoľvek plány na pravidlá a predpisy sa snažia dobehnúť, či už sú písané interne alebo zákonodarcami a regulátormi.

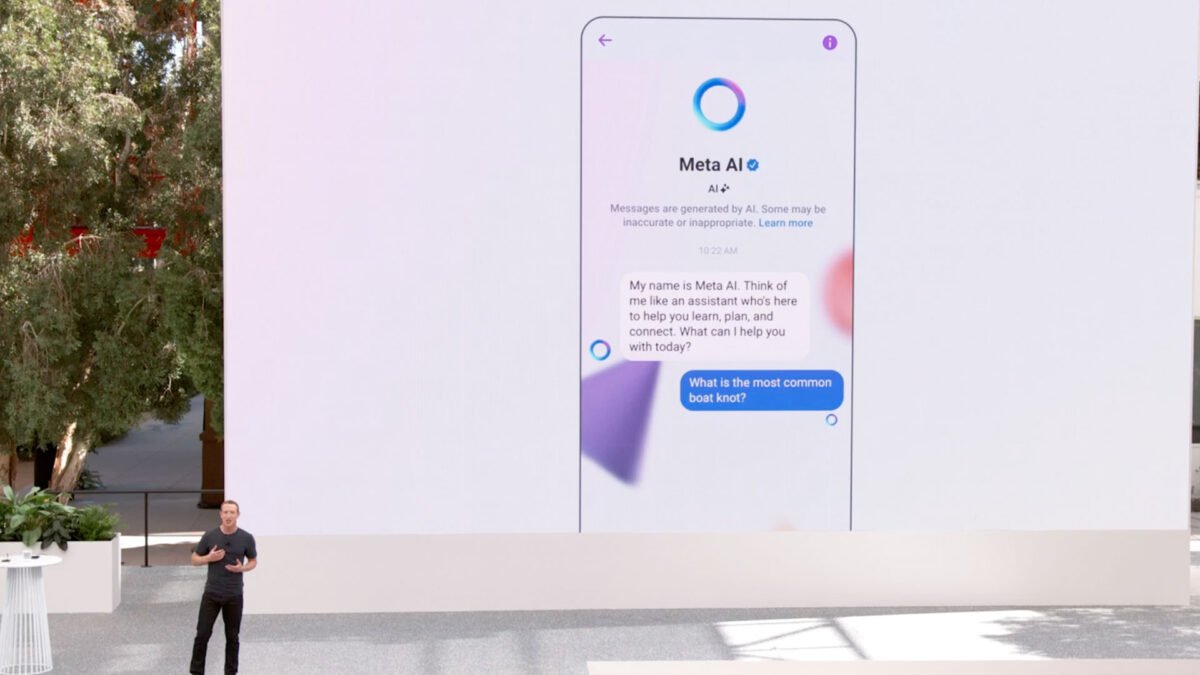

Pre väčšinu ľudí príbeh nastoľuje základné otázky bezpečnosti AI. Hoci by bolo ideálne, aby maloletí neinteragovali s všeobecnými AI chatbotmi bez dozoru, je to veľmi nepravdepodobné, súdiac podľa počtu detí a tínedžerov, ktorí priznávajú, že používajú nástroje ako ChatGPT na školské úlohy. Vyhnúť sa Meta AI je obzvlášť náročné, pretože spoločnosť zabudovala chatbota do Facebooku, WhatsApp, Messengeru a Instagramu. Používatelia môžu interagovať s AI postavami, ktoré sú často prezentované hravým, priateľským spôsobom, a Meta tieto nástroje predáva ako zábavné a dokonca aj vzdelávacie. Uniknuté smernice však naznačujú, že backend nie je vždy v súlade s týmto zdravým obrazom.

Členovia Kongresu už vyzvali na vypočutia a návrhy zákonov na riešenie tejto situácie, ale faktom je, že v súčasnosti existuje len málo právnych požiadaviek na moderovanie obsahu chatbotov, pre deti alebo iných. Reči o bezpečnosti AI neviedli k žiadnemu konkrétnemu národnému systému presadzovania práva. Množstvo spoločností zaoberajúcich sa AI urobilo veľký rozruch okolo svojho úsilia o to, aby boli ich produkty bezpečné a etické, ale ak je táto príručka spoločnosti Meta ilustratívna toho, čo dali dokopy iné spoločnosti, je pred nami ešte veľa práce a veľa otázok o tom, aké rozhovory tieto chatboty už viedli, najmä s deťmi.

AI modely môžu byť čoraz lepšie v napodobňovaní ľudského myslenia, ale v skutočnosti sú len zbierkou rozhodnutí ľudských programátorov, zámerných aj neúmyselných. Skutočnosť, že tieto pravidlá boli zjavne kodifikované v spoločnosti Meta, neznamená, že podobné príklady existujú v iných spoločnostiach, ale nie je to niečo, čo by sa dalo vylúčiť. A ak sa tieto rozhodnutia robia v zákulisí jednej z najmocnejších technologických spoločností na svete, čo iné sa potichu povoľuje?

AI chatboty sú len také dôveryhodné, ako sú neviditeľné pravidlá, ktoré ich riadia, a hoci je naivné plne dôverovať tvrdeniam akejkoľvek spoločnosti bez dôkazov, príručka spoločnosti Meta naznačuje, že používatelia by mali brať takéto tvrdenia s rezervou.

erichs211@gmail.com (Eric Hal Schwartz)