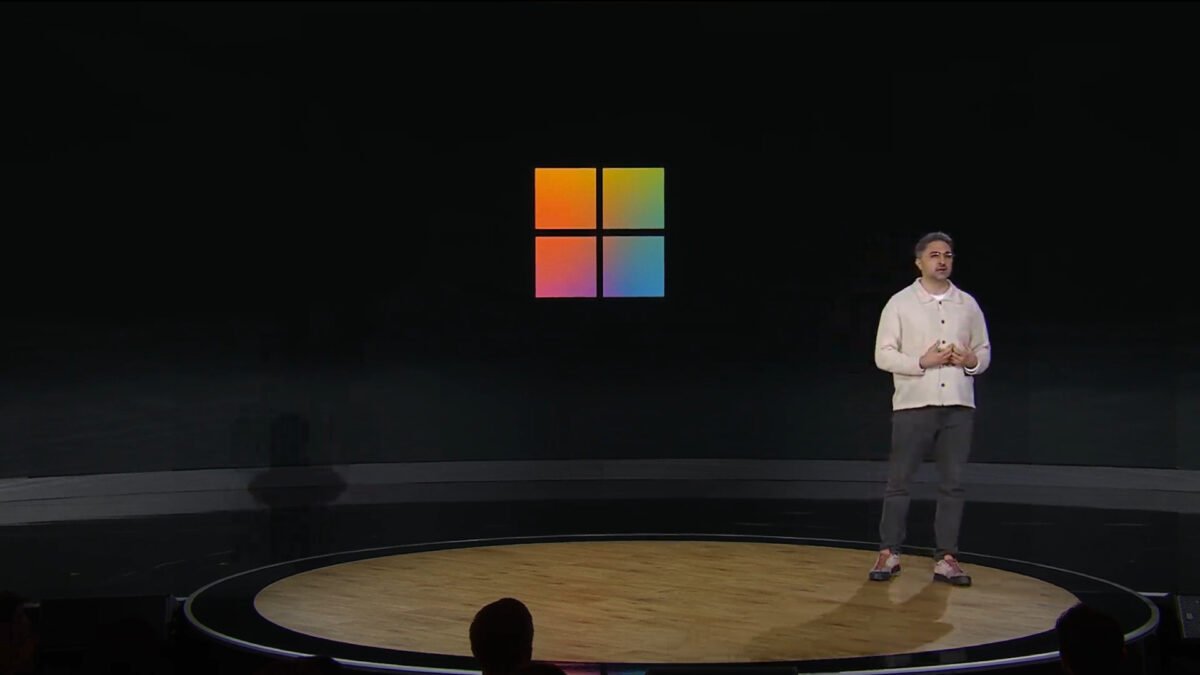

CEO spoločnosti Microsoft AI, Mustafa Suleyman, varuje, že AI chatboty by mohli efektívne imitovať vedomie. Bola by to len ilúzia, ale vytváranie citových väzieb k AI by mohol byť veľký problém. Suleyman hovorí, že je chybou opisovať AI, akoby mala pocity alebo vedomie, s vážnymi potenciálnymi dôsledkami.

AI spoločnosti, ktoré vychvaľujú svoje výtvory, môžu spôsobiť, že zložité algoritmy znejú doslova živo a vedome. Neexistuje žiadny dôkaz, že to tak naozaj je, ale CEO spoločnosti Microsoft AI, Mustafa Suleyman, varuje, že už len podnecovanie viery vo vedomú AI by mohlo mať hrozné následky.

Suleyman tvrdí, že to, čo nazýva „Zdanlivo vedomá AI“ (ZVAI), by čoskoro mohla konať a znieť tak presvedčivo živo, že rastúci počet používateľov nebude vedieť, kde sa ilúzia končí a realita začína.

Dodáva, že umelá inteligencia sa rýchlo stáva emocionálne presvedčivou natoľko, že oklame ľudí, aby uverili, že je vnímavá. Môže imitovať vonkajšie znaky vedomia, ako je pamäť, emocionálne zrkadlenie a dokonca aj zjavná empatia, spôsobom, ktorý spôsobuje, že sa k nim ľudia chcú správať ako k vnímavým bytostiam. A keď sa to stane, hovorí, veci sa skomplikujú.

„Príchod zdanlivo vedomej AI je nevyhnutný a nevítaný,“ píše Suleyman. „Namiesto toho potrebujeme víziu pre AI, ktorá môže naplniť svoj potenciál ako užitočný spoločník bez toho, aby sa stala obeťou jej ilúzií.“

Hoci sa to nemusí zdať ako problém pre bežného človeka, ktorý chce len, aby mu AI pomohla s písaním e-mailov alebo plánovaním večere, Suleyman tvrdí, že by to bol spoločenský problém. Ľudia nie sú vždy dobrí v rozpoznávaní autenticity alebo performativity. Evolúcia a výchova pripravili väčšinu z nás uveriť, že niečo, čo sa zdá, že počúva, rozumie a reaguje, je rovnako vedomé ako my.

AI by mohla označiť všetky tieto políčka bez toho, aby bola vnímavá, čím by nás oklamala do takzvanej „AI psychózy“. Časť problému môže byť v tom, že „AI“, ako ju v súčasnosti označujú korporácie, používa rovnaký názov, ale nemá nič spoločné so skutočnými sebauvedomujúcimi inteligentnými strojmi, ako boli zobrazené vo vedeckej fantastike za posledných sto rokov.

Suleyman uvádza rastúci počet prípadov, keď si používatelia vytvárajú bludné presvedčenia po dlhodobých interakciách s chatbotmi. Z toho maľuje dystopickú víziu doby, keď bude dosť ľudí oklamaných, aby presadzovali občianstvo AI a ignorovali naliehavejšie otázky o skutočných problémoch okolo technológie.

„Jednoducho povedané, moja hlavná obava je, že veľa ľudí začne tak silno veriť v ilúziu AI ako vedomých entít, že čoskoro budú presadzovať práva AI, model blahobytu a dokonca aj občianstvo AI,“ píše Suleyman. „Tento vývoj bude nebezpečným obratom v pokroku AI a zaslúži si našu okamžitú pozornosť.“

Napriek tomu, že sa to zdá ako prehnaný sci-fi druh obavy, Suleyman verí, že je to problém, na ktorý ešte nie sme pripravení sa vysporiadať. Predpovedá, že systémy ZVAI používajúce rozsiahle jazykové modely spojené s expresívnou rečou, pamäťou a históriou chatu by sa mohli začať objavovať v priebehu niekoľkých rokov. A nebudú pochádzať len od technologických gigantov s miliardovými rozpočtami na výskum, ale od každého s API a jedným alebo dvoma dobrými výzvami.

Nepríjemná AI

Suleyman nežiada zákaz AI. Ale nalieha na AI priemysel, aby sa vyhýbal jazyku, ktorý živí ilúziu strojového vedomia. Nechce, aby spoločnosti antropomorfizovali svoje chatboty alebo naznačovali, že produkt skutočne rozumie ľuďom alebo sa o nich stará.

Je to pozoruhodný moment pre Suleymana, ktorý spoluzakladal DeepMind a Inflection AI. Jeho práca v Inflection konkrétne viedla k AI chatbotu zdôrazňujúcemu simulovanú empatiu a spoločenstvo a jeho práca v spoločnosti Microsoft okolo Copilot viedla k pokroku v jeho napodobňovaní emocionálnej inteligencie tiež.

Rozhodol sa však nakresliť jasnú čiaru medzi užitočnou emocionálnou inteligenciou a možnou emocionálnou manipuláciou. A chce, aby si ľudia pamätali, že produkty AI sú v súčasnosti skutočne len inteligentné modely rozpoznávania vzorov s dobrým PR.

„Rovnako ako by sme mali vytvárať AI, ktorá uprednostňuje interakciu s ľuďmi a interakcie v reálnom svete v našom fyzickom a ľudskom svete, mali by sme budovať AI, ktorá sa vždy prezentuje len ako AI, ktorá maximalizuje úžitok a zároveň minimalizuje znaky vedomia,“ píše Suleyman.

„Namiesto simulácie vedomia sa musíme zamerať na vytvorenie AI, ktorá sa vyhýba týmto vlastnostiam – ktorá netvrdí, že má skúsenosti, pocity alebo emócie ako hanba, vina, žiarlivosť, túžba súťažiť a tak ďalej. Nesmie spúšťať ľudské okruhy empatie tým, že tvrdí, že trpí alebo že si želá žiť autonómne, mimo nás.“

Suleyman nalieha na ochranné opatrenia, aby zabránil spoločenským problémom, ktoré vzniknú z emocionálneho prepojenia ľudí s AI. Skutočné nebezpečenstvo z pokročilej AI nespočíva v tom, že sa stroje prebudia, ale v tom, že by sme mohli zabudnúť, že sa tak nestalo.

erichs211@gmail.com (Eric Hal Schwartz)